2025 年,全球 AI 服务器市场规模预计突破 1500 亿美元,年复合增长率达 36.9%,主要受益于大模型训练和智能算力需求。AI 服务器对 PCB 的需求集中在高多层(>28 层)、高密度(线宽 / 间距≤30μm)和高速信号传输(>56Gbps)三大场景,其中高端 HDI 板价值量达 5000-8000 元 / 台,是普通服务器的 10-15 倍。鼎泰高科开发的 0.01mm 微钻和涂层技术,支持 32 层 PCB 钻孔,良率达 92%,已应用于英伟达 H100 芯片基板。

一、技术升级与产品创新

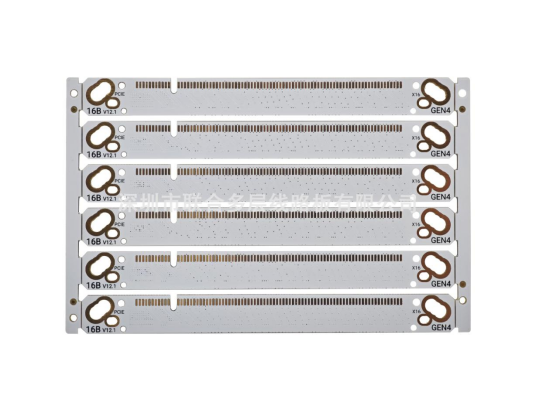

· 32 层高多层板:胜宏科技的 32 层 HDI 板,集成 12,000 个 BGA 引脚,信号传输速率提升至 112Gbps,适配 AMD MI300X 芯片的算力需求。

· 液冷散热设计:华为 AI 服务器采用陶瓷基板与冷却液流道协同工作,使 GPU 结温降低 25℃,故障率下降 50%。

· 材料创新:南亚塑胶推出的高速覆铜板(Df=0.002),在 25GHz 频段信号损耗较传统材料降低 40%,已应用于阿里云服务器。

二、制造工艺与供应链动态

· 激光直接成像(LDI):大族激光的 LDI 设备支持 5μm 线宽,生产效率较传统曝光机提升 3 倍,良率达 92%。

· 区域产能布局:鹏鼎控股越南厂投资 18 亿元建设 AI 用 HDI 项目,年产能 15 万平方米,绑定苹果、Meta 等客户。

· 国产替代:深南电路开发的 AI 服务器用 PCB 通过英伟达认证,成本较罗杰斯方案降低 30%。

三、市场需求与应用场景

· 大模型训练:谷歌 TPU v5 芯片采用 28 层 HDI 板,支持 1.2PetaFLOPS 算力,信号传输速率提升至 56Gbps。

· 智能算力中心:中国 “东数西算” 工程的贵州枢纽,单节点服务器集群需配备 2000 片以上 32 层 HDI 板。

· 边缘计算:特斯拉 FSD 芯片采用 28 层 PCB,集成 128 个 MEMS 传感器,适配自动驾驶的实时决策需求。

四、成本与可靠性挑战

· 成本对比:32 层 HDI 板成本是普通板的 8 倍,但规模化生产后有望降至 5 倍。

· 可靠性测试:在 85℃/85% RH 环境下,绝缘电阻下降率<5%,较传统 FR-4 改善 70%。

· 环保要求:欧盟 RoHS 指令要求 AI 服务器 PCB 铅含量<0.1%,推动无铅焊接工艺普及。

总结:AI 服务器 PCB 的技术迭代是算力革命的硬件基石。企业需在材料、工艺与客户绑定上持续突破,同时探索循环经济模式,以应对行业高速增长带来的挑战。

网友回应